增强现实显微镜——实时自动癌症检测

背景介绍

在医学中显微镜是肿瘤诊断的黄金准则。在病理分期中染色剂通过淋巴和新陈代谢传播到其他器官,而医生通过检测组织部位来确定肿瘤的类型和级别。例如,在乳腺癌检测中,医生需要通过测量最大肿瘤病灶维度和癌细胞数目来确定前哨淋巴数目。虽说这些任务耗时,冗长而乏味,但是他们对医生的诊疗具有重要的作用。最后,HER2,ER,PR,IHC等指标对癌症诊断也具有重要作用。但是这些肿瘤分类技术的进步也增加了医生的负担,降低了医生的诊断效率。

通过人工智能,特别是深度学习是解决该问题的潜在方法,为了缩小深度学习和显示世界的鸿沟,谷歌提出了一个增强的光学显微镜系统,该系统能够实时的使用,并展示智能算法的检测结果。在本文中,主要对谷歌提出的集成了增强现实的显微镜自动化癌症检测系统(ARM)。

系统架构

为了实现辅助诊断,ARM需要确保检测准确率高、速度快和过程透明。首先ARM系统必须提供必要的数字信息,即深度学习的分类结果,并且确保检测的准确性;其次,系统的速度必须能够跟得上显微镜下方切片的移动速度;最后,数字内容必须能够有效的展示给操作人员,所有的数字特征必须与原图像在屏幕上准确的展示。

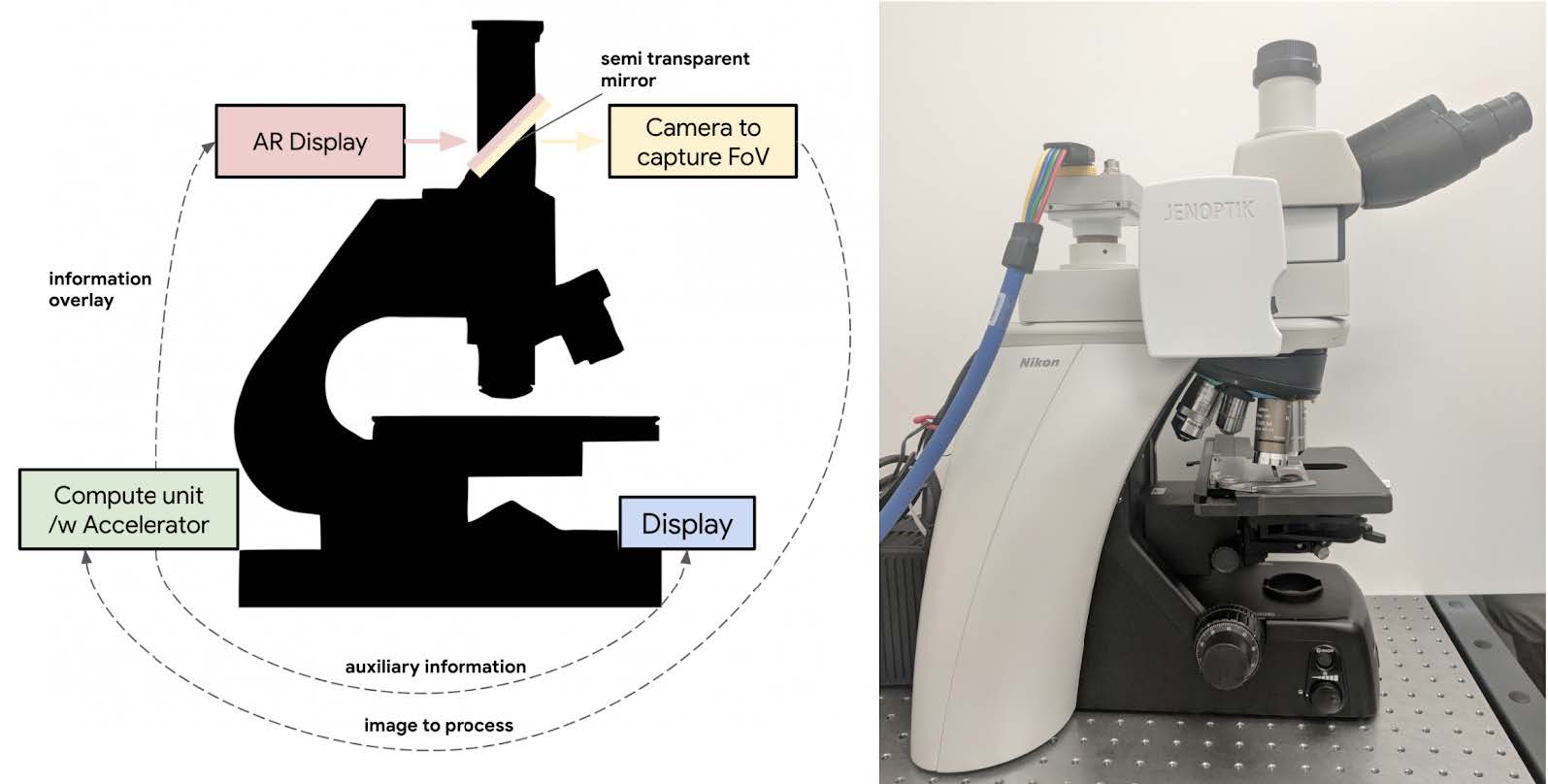

ARM系统主要通过三个主要部件来实现端到端的实时诊断辅助功能。主要包括:增强的光学显微镜;一台用于手机显微镜图像并运行深度学习算法的服务器;和一系列训练好的深度学习算法。下图是ARM系统的架构图:

摄像头-机械设计

在上图中展示的增强显微镜系统包含一个尼康摄像头以及定制的用于捕捉高分辨率图像的模块。

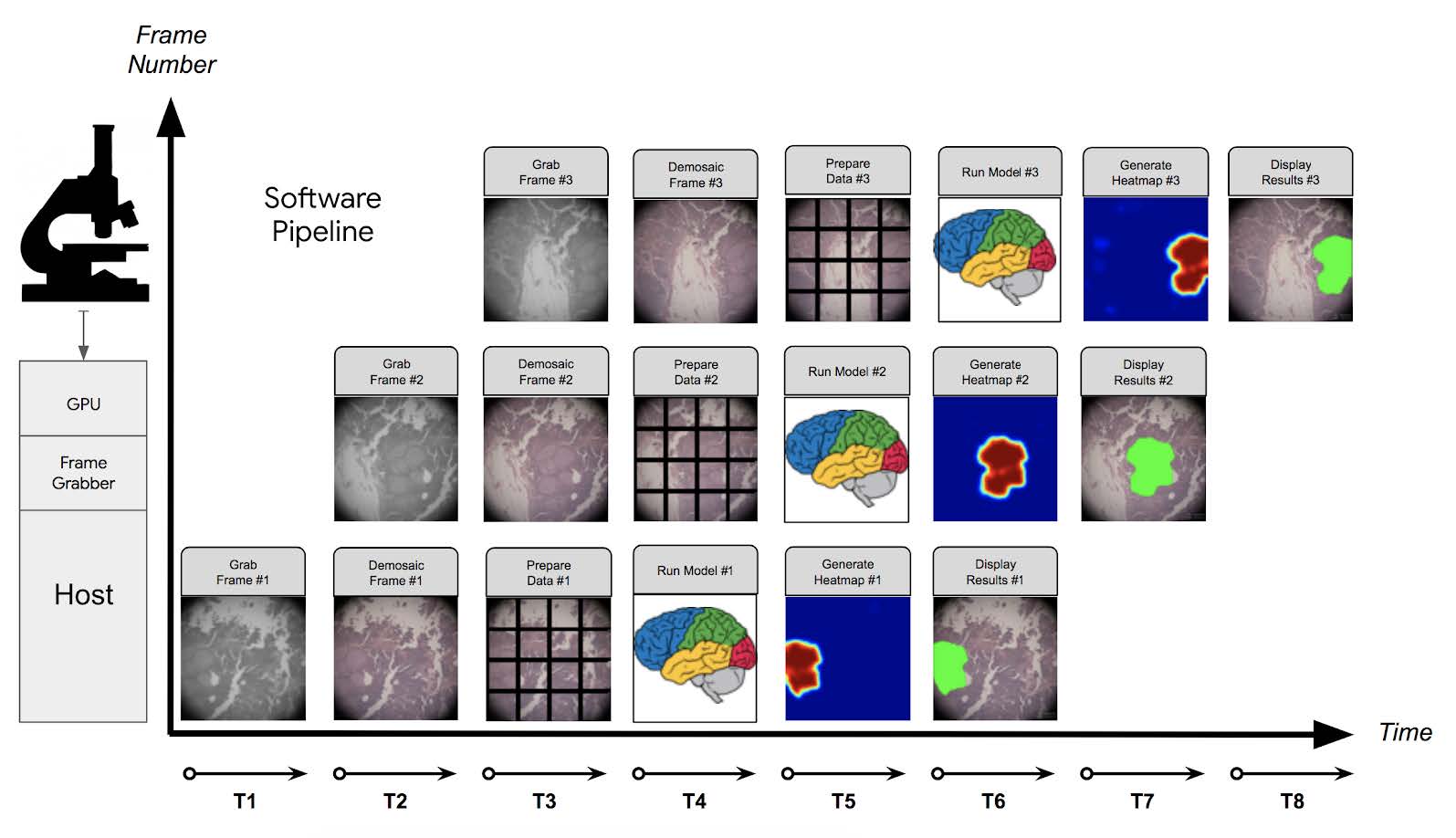

软件和硬件系统

软硬件系统主要是用于接收显微镜获取图像和运行深度学习算法的服务器。该系统的端到端检测的基本流程如下图所示。为了提高检测的效率,在实现时采用C++和TensorFlow实现。

数据获取

在本系统中,我们以两种肿瘤诊断为例,其中染色节点检测,本文使用Cancer Metastases in Lymph Nodes (Camelyon) 2016 竞赛的数据集进行训练。此外,还使用了3DHISTECH Pannoramic 250 Flash II和Hamamatsu XR C12000数据集。

训练过程

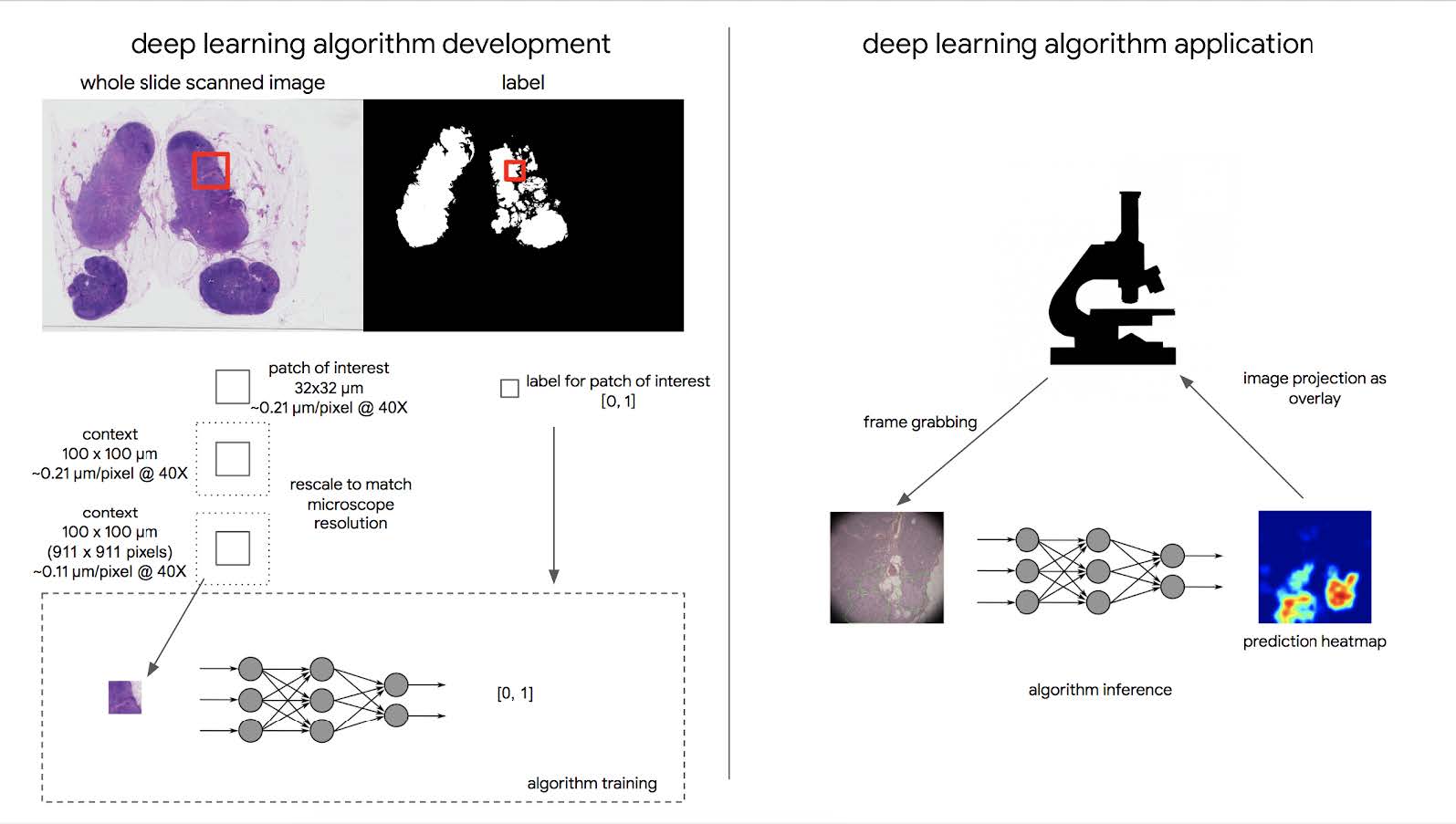

本文主要使用的是基于Inception V3-FCN的卷积神经网络进行训练,深度学习图像分析包括两个阶段:算法开发和应用。具体如下图所示。

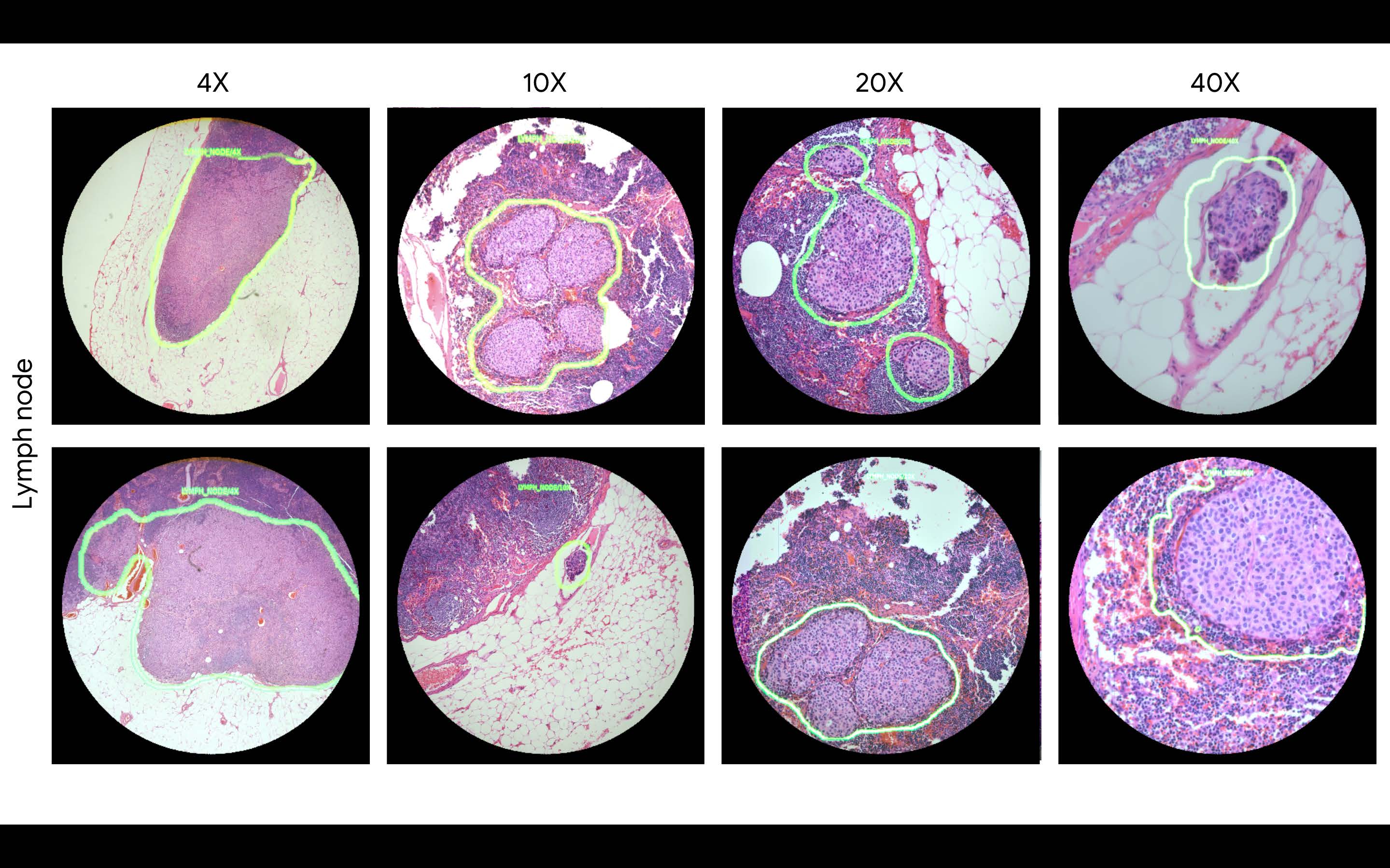

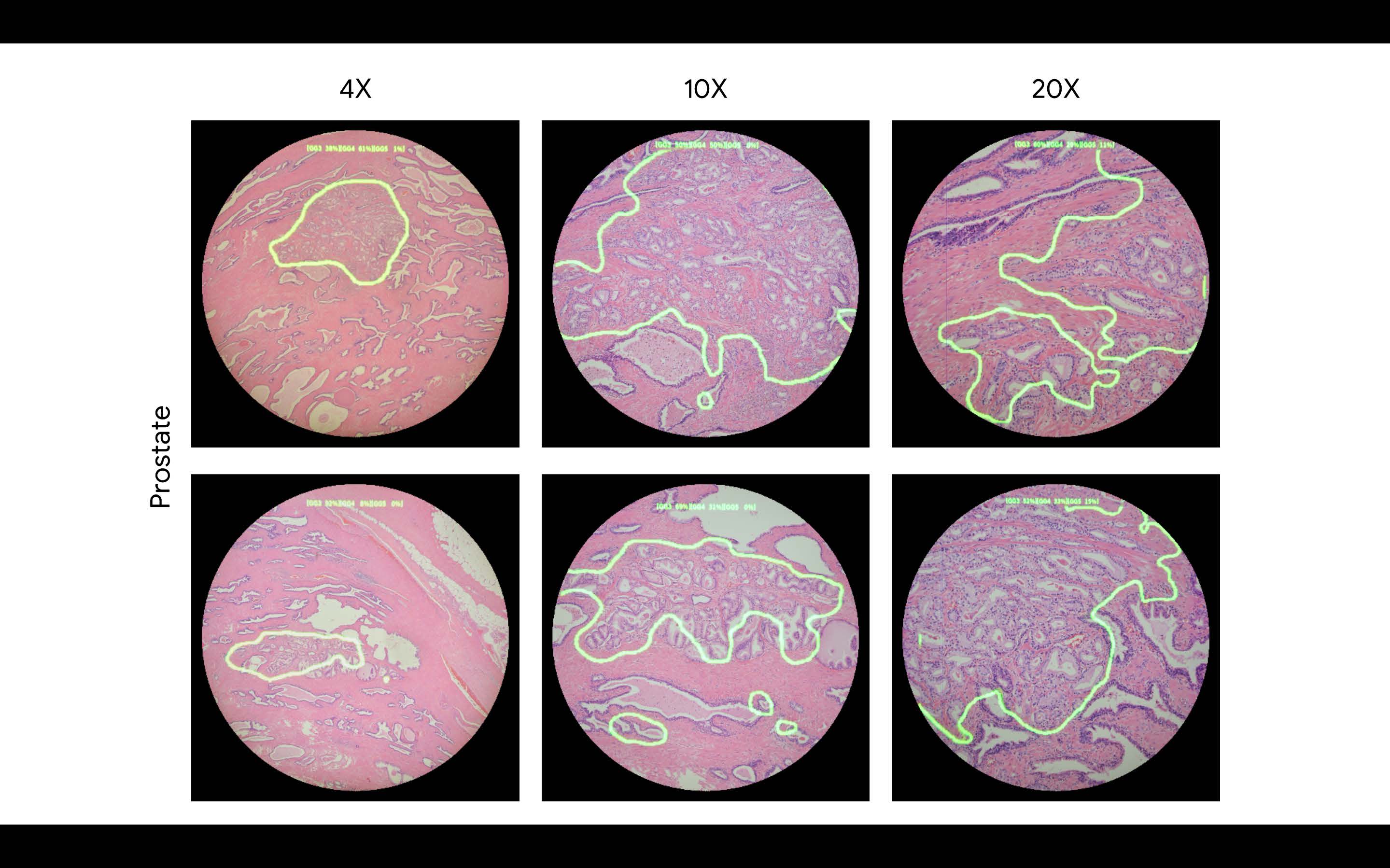

在算法开发阶段,我们使用分别放大到4,10,20,40倍到$911\times 911$的染色节点和前列腺图像和对应的标签以及肿瘤分类进行训练。通过调整神经网络的权重,确保预测结果与标记结果之间的误差足够小,神经网络就学会了识别不同的病灶和诊断。在神经网络的训练过程中,我们将整个切片图像从扫描图像到显微镜图像大小。在实际应用中显微镜输入的s是实时获取的$5120\times5120$图像。网络的输出是每个像素点是癌症区域的概率热图。该热图可以直接通过彩图显示也可以通过

实验结果

在实验中,作者对检测效率以及在乳腺癌和前列腺癌上的检测准确率进行了基本测试。从效率来看,每秒检测10帧,基本能达到实时。

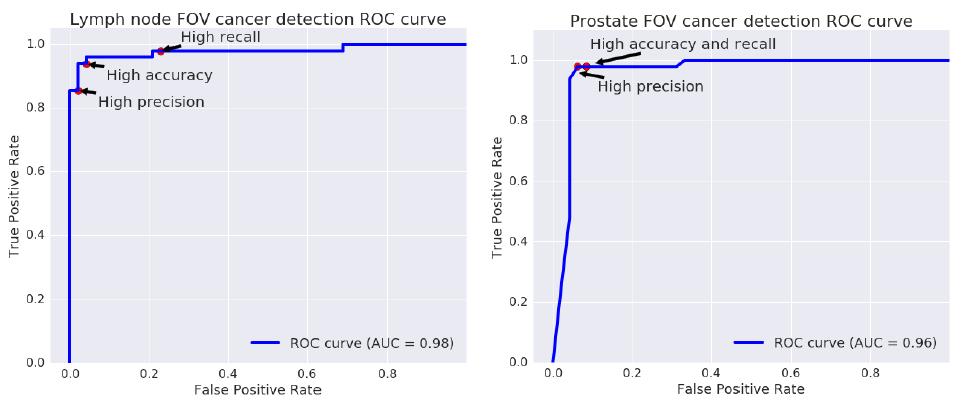

ARM在96个视角的测试结果表明,在淋巴前哨细胞检测中的AUC值达到了98%,而在前列腺癌中达到了96%。此外,关于精确率、准确率和召回率都可以通过下图的ROC曲线了解。

讨论

如果从论文的创新性上来讲,本文的创新性较低。但是本文首次实现了将深度学习集成到了显微镜系统中,完成了从显微镜到检测结果端到端的检测系统。系统的基本架构设计为后续的设备研发奠定了方向。在该论文中提到的检测准确率和检测效率基本上能满足了检测的需要。但是真正要临床应用还存在着许多需要解决的问题。首先最关键的一点见是神经网络检测过程中的透明性问题,目前训练的网络还是一个黑盒子,检测准确率也都是在标记数据集上的训练,当检测误差产生时,如何去定位,如何去认责?目前的癌症检测,还仅仅是对两种癌症取得了较好的效果,对其他类型的癌症,是否需要改变整个系统的结构,还是仅仅只需要修改训练的深度学习算法就行?

本文最大的贡献是实践了完整的深度学习用于诊断设备的工作流程,并且完成了深度学习算法在医疗设备中的嵌入,提供了一套弹性的,可扩展的端到端癌症检测框架。在未来的自动化肿瘤检测中,一方面要考虑如何将检测算法集成到现有设备中,另一方面也要考虑如何将检测结果实时的反馈给医生,用于参考。因为就目前的网络结构黑匣子的特点来讲,还不能以深度学习算法的检测结果直接做诊断。